- 核心技术

- 以原创技术体系为根基,SenseCore商汤AI大装置为核心基座,布局多领域、多方向前沿研究,

快速打通AI在各个垂直场景中的应用,向行业赋能。

ISMAR 2021|商汤和浙江大学联合提出移动端高质量在线三维扫描仪Mobile3DScanner

Mobile3DScanner: An Online 3D Scanner for High-quality Object Reconstruction with a Mobile Device

Part 1 相关工作

目前主要的静态物体重建方法可以分为两类:基于RGBD相机的三维扫描重建与基于图像的多视图重建。

1.1 基于RGBD相机的三维扫描重建

此类方法以KinectFusion[3]为代表,对输入的深度图利用ICP求解相机位姿,并将深度图融合成一个全局的TSDF模型,类似的工作还有InfiniTAM[2]以及BundleFusion[1],但由于计算复杂度以及内存占用的原因,它们只能在PC端运行。此外,还有[8][9][10]等结合用户手操作的交互式扫描重建方法以及基于非刚性注册的物体扫描重建[11],这类方法大多适用于小物体重建。

1.2 基于图像的多视图重建

此类方法致力于在移动设备上实现基于单目RGB视频的物体扫描重建,他们利用多视图立体匹配的方法恢复出单帧的深度并将深度融合成TSDF模型[12][13]或者Surfel模型[14][15]。总体而言,这类方法重建出的模型在模型精度以及完整度上与基于RGBD相机的重建方法相比还有一定差距。

Part 2 方法描述

2.1 系统概述

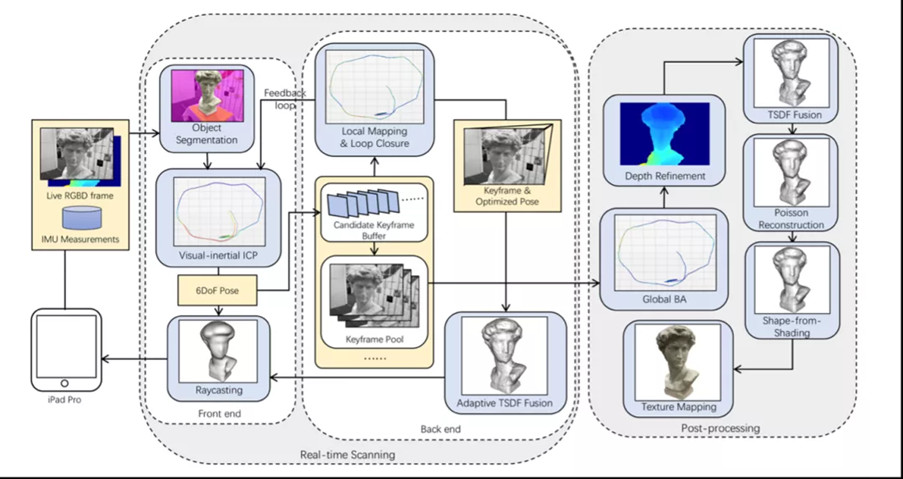

如图1所示,我们的重建系统要求用户配备一个带有RGBD摄像头的移动计算设备,并将待扫描的物体放置在一个水平面上。用户开始扫描后,系统将自动分割出物体区域并实时求解相机位姿,深度传感器获取到的深度数据将被融合成TSDF模型并渲染供用户作实时预览。扫描结束后,系统将对所有的关键帧进行全局BA并结合多视图立体匹配方法来优化关键帧的深度,最终融合出的TSDF模型经由泊松重建[16]、Shape-from-Shading以及纹理贴图后,得到最终带纹理的重建模型。

我们用 Semantic Field 来实现对人脸特征连续且高细粒度可控的编辑。对话功能则由 Language Encoder和Talk模块来实现。接下来我们解释各个模块的工作原理和效果。

2.2 ICP与IMU松耦合

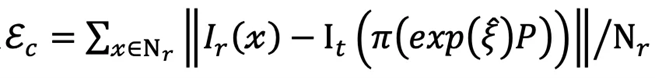

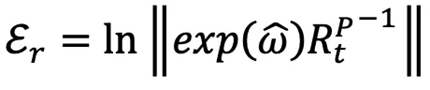

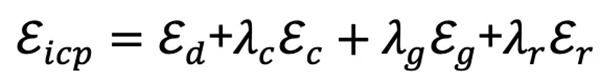

移动平台算力有限,我们提出将ICP与IMU进行松耦合来提升相机位姿求解的鲁棒性与精度。我们首先利用初始两帧的ICP结果对IMU模块进行初始化,IMU初始化完成后即可依据输入的IMU数据为当前帧提供位姿预测,我们再将IMU的预测值加入ICP能量项来求解当前帧的相机位姿,当前帧位姿求解完成后,其结果将作为约束来进一步优化IMU的状态量[17]。原本的ICP能量项[4]考虑了两帧之间的颜色差和深度差:

![]()

在此基础上我们加入了IMU的旋转约束以及重力约束:

![]()

构建最终的能量方程

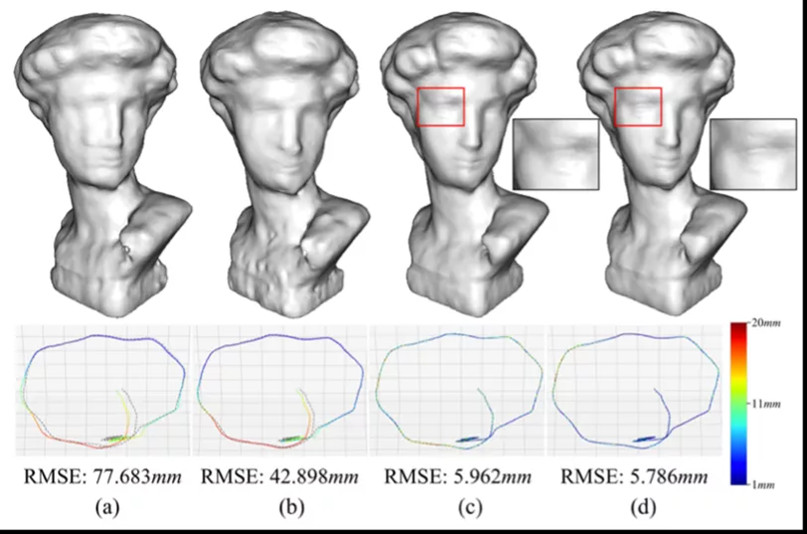

图2展示了我们方法的有效性。

图2.(a)Open3D[4] ICP. (b)引入IMU. (c)(d)加入LBA以及Loop Closure.

2.3 自适应调节体素的TSDF

移动平台上内存有限,必须约束TSDF模型的大小,我们提出一种自适应调节体素的TSDF方法,当其内存占用量达到阈值时,系统将自动创建一个新的TSDF,其体素大小为旧体素的1.5倍,新体素的符号距离以及权重无需重新计算,可通过旧体素三线性插值高效获取。这个策略可保证TSDF模型的内存占用不会超过用户设定的阈值,从而在移动设备上能支持大物体的扫描重建。

2.4 结合深度先验的多视图立体匹配

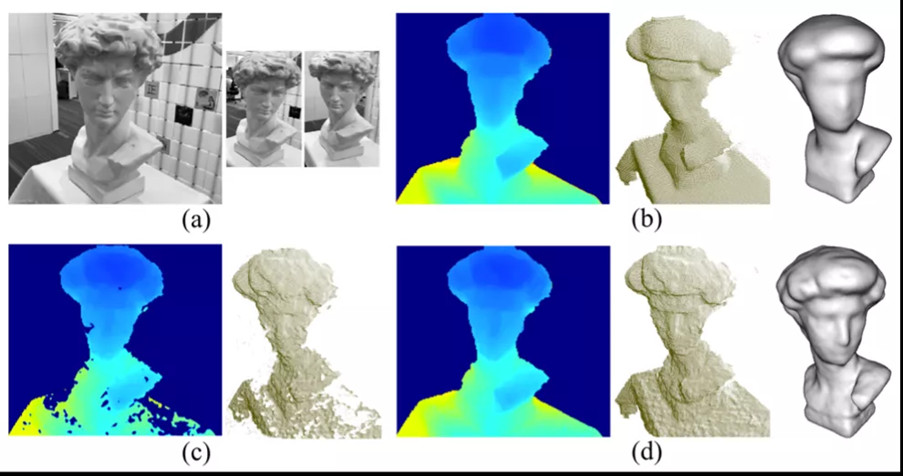

消费级的深度传感器例如dToF,其获取的深度存在不同程度的错误以及过平滑问题,我们提出一种结合深度先验的SGM方法,利用视觉信息来提升深度图的精度,其效果如图3所示。

图3.(a)关键帧. (b)dToF单帧深度以及融合后的模型. (c)SGM[6]单帧深度. (d)结合深度先验的SGM及其模型.

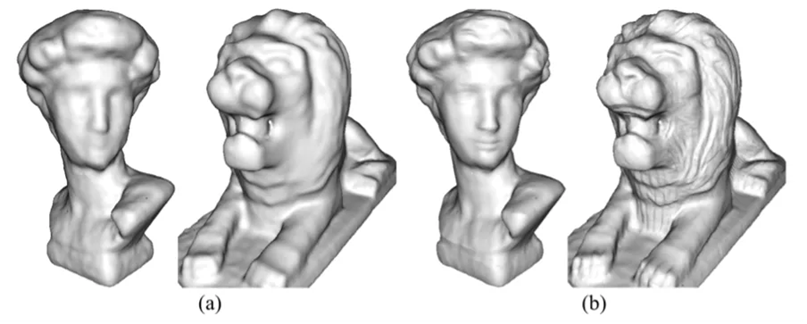

2.5 高效的Shape-from-Shading

Shape-from-Shading可以提升重建模型的几何细节,但目前已有的实现方案无论是计算复杂度还是内存占用都远无法在移动平台上实施。不同于现有方案,我们直接在重建好的模型上优化三角面片的法向量,再结合方法[5]更新模型顶点。以图4中的“David”为例,我们的方法在iPad Pro2020 CPU上耗时3.24秒,优化后模型精度RMSE/MAE为3.12mm/2.473mm。而Intrinsic3D[7]在PC端Intel Core i7 7700K CPU上耗时81分钟得到略优的结果,RMSE/MAE为2.89mm与2.16mm。

图4.(a)初始模型. (b)SFS优化后的模型

Part 3 实验结果

3.1 模型精度对比

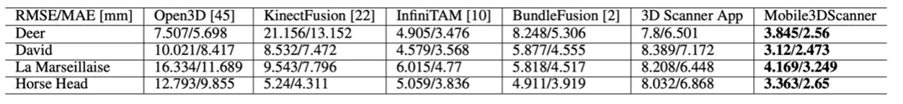

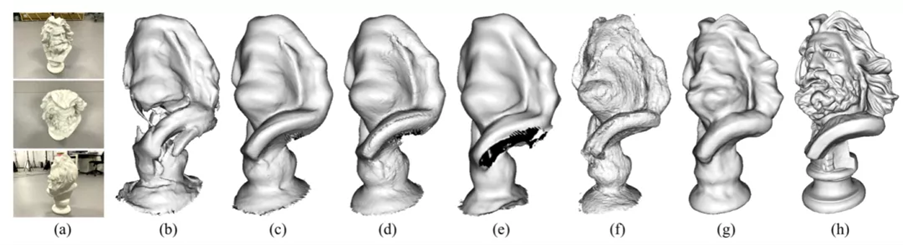

我们用iPad Pro2020录制了四组测试数据来对比我们的方案与现有的方案在模型精度上的差异,ground truth由商业扫描仪获取。表格1以及图5显示我们的方法在模型精度以及完整度上都取得了最优结果。

表格1.模型精度对比(RMSE/MAE)

图5.与现有SOTA方法的模型对比.

(b)Open3D[4].(c)KinectFusion[3].(d)InfiniTAM[2].(e)BundleFusion[1].(f)3D Scanner App.(g)我们的方法.(h)GT.

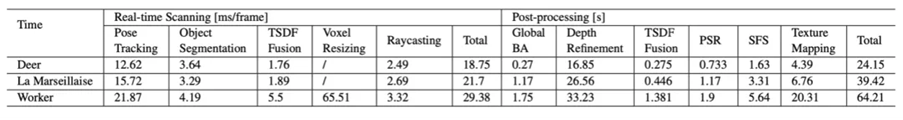

3.2 耗时统计

表格2统计了算法各个步骤在iPad Pro2020上的耗时,我们的方法在大物体“worker”上也达到了实时。

表格2:算法模块耗时统计

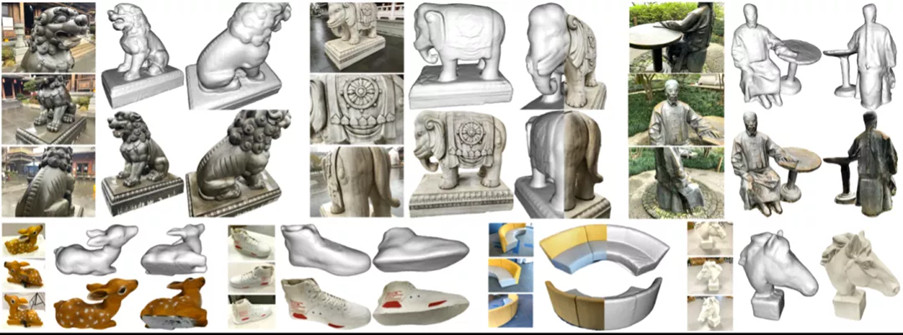

3.3 更多结果

Reference:

[1] Dai, M. Nießner, M. Zollho ̈fer, S. Izadi, and C. Theobalt. BundleFusion: Real-time globally consistent 3D reconstruction using on-the-fly surface re-integration. ACM Transactions on Graphics, 36(4):1, 2017.

[2] O. Kahler, V. Prisacariu, C. Ren, X. Sun, P. Torr, and D. Murray. Very high frame rate volumetric integration of depth images on mobile devices. IEEE Transactions on Visualization and Computer Graphics, 21(11):1–1, 2015.

[3] R. A. Newcombe, S. Izadi, O. Hilliges, D. Molyneaux, and A. W. Fitzgibbon. KinectFusion: Real-time dense surface mapping and tracking. In IEEE International Symposium on Mixed and Augmented Reality, 2011.

[4] Q. Zhou, J. Park, and V. Koltun. Open3D: A modern library for 3D data processing. arXiv:1801.09847, 2018.

[5] H. Zhao, K. Su, C. Li, B. Zhang, L. Yang, N. Lei, X. Wang, S. J. Gortler, and X. Gu. Mesh parametrization driven by unit normal flow. Computer Graphics Forum, 39(1):34–49, 2020.

[6] H. Hirschmu ̈ller. Accurate and efficient stereo processing by semi-global matching and mutual information. In IEEE Computer Society Conference on Computer Vision and Pattern Recognition, vol. 2, pp. 807–814, 2005.

[7] R. Maier, K. Kim, D. Cremers, J. Kautz, and M. Nießner. Intrinsic3D: High-quality 3D reconstruction by joint appearance and geometry optimization with spatially-varying lighting. In IEEE International Conference on Computer Vision, 2017.

[8] S. Rusinkiewicz, O. Hall-Holt, and M. Levoy. Real-time 3D model acquisition. ACM Transactions on Graphics, 21(3):438–446, 2002.

[9] D. Tzionas and J. Gall. 3D object reconstruction from hand-object interactions. In IEEE International Conference on Computer Vision, pp. 729–737, 2015.

[10] T. Weise, B. Leibe, and L. Van Gool. Accurate and robust registration for in-hand modeling. In IEEE Conference on Computer Vision and Pattern Recognition, pp. 1–8, 2008.

[11] J. Xu, W. Xu, Y. Yang, Z. Deng, and H. Bao. Online global non-rigid registration for 3D object reconstruction using consumer-level depth cameras. 37(7):1–12, 2018.

[12] P. Ondru ́sˇka, P. Kohli, and S. Izadi. MobileFusion: Real-time volumetric surface reconstruction and dense tracking on mobile phones. IEEE Trans- actions on Visualization and Computer Graphics, 21(11):1251–1258, 2015.

[13] V. Pradeep, C. Rhemann, S. Izadi, C. Zach, M. Bleyer, and S. Bathiche. MonoFusion: Real-time 3D reconstruction of small scenes with a single web camera. In IEEE International Symposium on Mixed and Augmented Reality, 2013.

[14] P. Tanskanen, K. Kolev, L. Meier, F. Camposeco, O. Saurer, and M. Polle- feys. Live metric 3D reconstruction on mobile phones. In IEEE Interna- tional Conference on Computer Vision, pp. 65–72, 2013.

[15] K. Kolev, P. Tanskanen, P. Speciale, and M. Pollefeys. Turning mobile phones into 3D scanners. In IEEE Conference on Computer Vision and Pattern Recognition, 2014.

[16] M. Kazhdan. Poisson surface reconstruction. In Eurographics Symposium on Geometry Processing, 2006.

[17] T. Qin, P. Li, and S. Shen. Vins-mono: A robust and versatile monocular visual-inertial state estimator.

返回

返回