- 核心技术

- 以原创技术体系为根基,SenseCore商汤AI大装置为核心基座,布局多领域、多方向前沿研究,

快速打通AI在各个垂直场景中的应用,向行业赋能。

CVPR 2021 Oral|商汤提出最新深伪评测基准 ForgeryNet:左右互搏——论火眼金睛的修炼

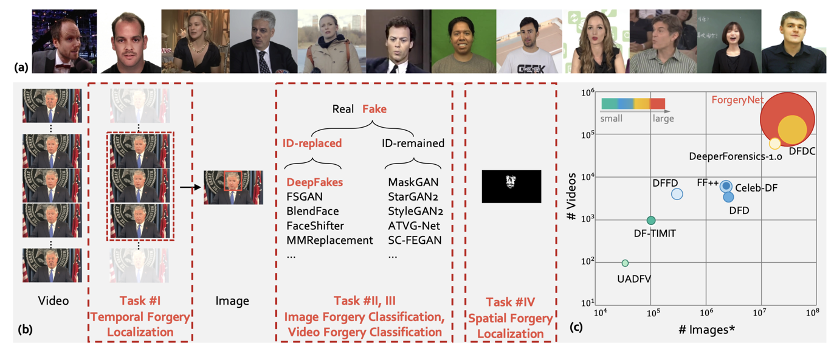

在CVPR 2021上,商汤通用智能通用视觉团队针对现有的人脸深度伪造技术发展对社会安全方面造成了威胁的现象,构建了一个目前维度最大最丰富的公开数据集和评测基准。在数据规模方面,ForgeryNet包含了 290万张图像和221,247个视频,15个人脸深度伪造操作(其中包括7个图像层面的伪造方法,8个视频层面的伪造方法),加入了多种扰动(36种以上的扰动)以模拟真实世界中遇到的挑战,并包含丰富数据标注以供研究者进行探索(其中包含630万个分类标签,290万个伪造空间定位标注和221,247个时序伪造标注);在评测方法上,提出了四种不同的图片级和视频级评测方法。我们希望ForgeryNet丰富的数据、标签、质量和多样性能够促进人脸伪造分析等领域的进一步研究和创新。

这项研究由商汤通用智能通用视觉团队、北京邮电大学、北京航空航天大学、中国科学技术大学、南洋理工大学共同完成。

论文名称:

ForgeryNet: A Versatile Benchmark for Comprehensive Forgery Analysis

Part 1 问题和挑战

逼真的人脸深度伪造技术,尤其是最近的深度学习的DeepFake技术引起了广泛的社会关注,人们担心这些技术可能被恶意滥用以欺骗性地伪造人脸。开发用于面部伪造分析的可靠方法,以区分图像和视频是否被操纵以及在何处被操纵是计算机视觉中一个重要方向。近年来人脸伪造的数据集已经被提出很多,但是,现有的数据集依然存在有局限性:

1. 数据缺乏:目前的数据集最多包含10万个伪造视频或24万张伪造图片。ForgeryNet提供了至少12万个伪造视频和上百万的伪造图片。

2. 多样性缺乏:目前的数据集最多只用了8种面部篡改方式和19种后处理扰动。ForgeryNet从人脸位姿、表情、光照、场景、人脸大小等多个维度,收集了不同相机采集、不同分辨率的未受控原始数据,使用了 15种不同的方法对面部进行修改,并将36种后处理扰动方式的多种组合应用于生成的视频/图片上。

3. 性能饱和:目前很基础的深度学习模型,就可以在当前数据集上达到非常好的结果。这是因为现有的数据集场景较为简单,和真实的场景有差距。

4. 数据标注和任务多样性缺乏:现有的数据集往往只关注于视频/图片是否被操纵的二分类结果中,较少提供其他的标注信息。在这个数据集中,我们不仅提供了真实和伪造的2分类标签,还提供了具体伪造的方法、伪造的空间位置的掩码和时间拼接的标签信息。同时,为了丰富伪造分析的维度,我们还提出了四个伪造分析的任务,分别是图片分类、视频分类、空间定位和时间定位。

Part 2 数据集丰富的数据和标注

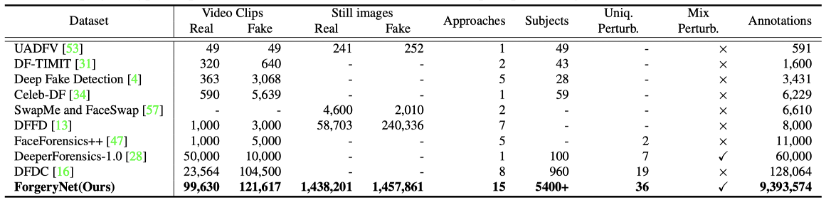

我们从四个数据集中收集角度、表情、身份、照明、场景等各种维度的原始数据。ForgeryNet 包含了 290 万张图像和221,247个视频,15个人脸深度伪造操作(其中包括7个图像层面的伪造方法,8个视频层面的伪造方法),扰动(36种以上的扰动)和数据标注(其中包含630万个分类标签,290万个伪造空间定位标注和221,247个时序伪造标注),各种伪造的数据分布,如图2所示。与各种伪造数据集进行比较, ForgeryNet在规模和多样性方面均超过任何其他数据集。它提供视频和图像两种数据,伪造数据是通过2大类中的15种操纵方法构建的,具体的方法将在后面介绍。

图 1 与其他基准的对比

图 2 视频及图片伪造数据分布图

Part 3 伪造方法介绍

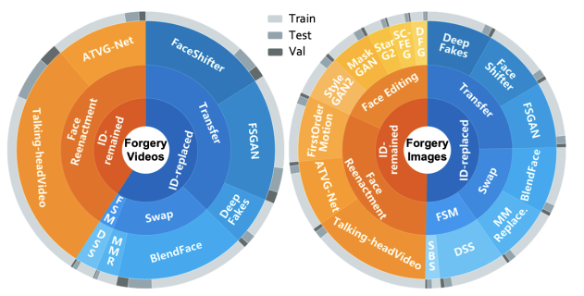

图 3 伪造方法分类

3.1 身份信息保留的伪造方式

图 3(a)中的身份保留伪造方法保留了![]() 的身份,并且以

的身份,并且以![]() 的对应属性驱动改变了

的对应属性驱动改变了![]() 的表情、嘴、头发和姿势等与身份无关的内容。我们采用八种伪造方法,将其分为两个子类型:

的表情、嘴、头发和姿势等与身份无关的内容。我们采用八种伪造方法,将其分为两个子类型:

1)通过面部动作重现的操纵方式,![]() (i,a)保留了其身份,但是其固有属性如姿势、嘴巴动作和表情受到了属性源

(i,a)保留了其身份,但是其固有属性如姿势、嘴巴动作和表情受到了属性源![]() 的操纵并形成了

的操纵并形成了![]() 操纵,其中指a表示属性。

操纵,其中指a表示属性。

2)通过面部编辑的操纵方式,![]() (i,a)的外部属性发生了变化,例如面部毛发、年龄、性别和种族,以获得

(i,a)的外部属性发生了变化,例如面部毛发、年龄、性别和种族,以获得![]() 。

。

3.2 身份信息修改的伪造方式

图3(b)中的身份变化的伪造方法将的身份信息替换为![]() 的身份信息。我们采用了7种伪造方法,共分为三种类型:

的身份信息。我们采用了7种伪造方法,共分为三种类型:

1)人脸迁移![]() 将身份有关的内容和身份无关的内容(例如表情和姿态)都从

将身份有关的内容和身份无关的内容(例如表情和姿态)都从![]() 转移到

转移到![]() 。

。

2)身份交换![]() 仅将s身份从源

仅将s身份从源![]() 交换到目标

交换到目标![]() ,这意味着身份无关的内容由

,这意味着身份无关的内容由![]() 保留。

保留。

3)人脸堆栈操纵指的是连续对视频/图片进行保留身份和修改身份的操纵行为。

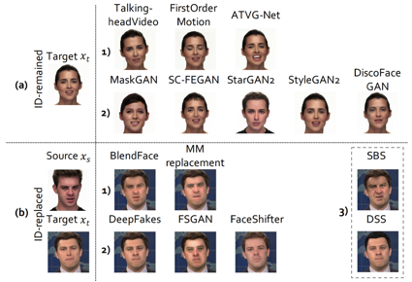

Part 4 伪造的流程

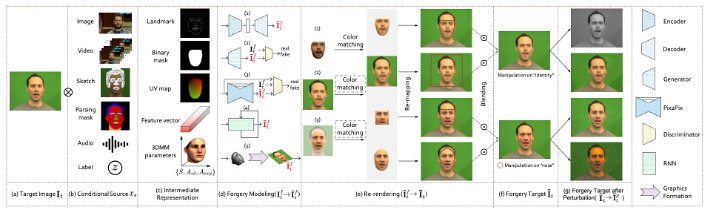

我们分别从换脸、面部编辑、动作重现的三个类别共15种方法对收集的数据进行面部伪造,整个生成的步骤如图4所示。

图 4 图像操纵示意图

(a)~(c) ,目标图像始终由![]() 表示,而面部伪造的驱动源

表示,而面部伪造的驱动源![]() 则有多种条件的格式,如图像、图像序列、草图、人脸五官解析的掩码、音频、标签,甚至是噪声。我们首先在这一步中对

则有多种条件的格式,如图像、图像序列、草图、人脸五官解析的掩码、音频、标签,甚至是噪声。我们首先在这一步中对![]() 进行裁剪和对齐目标人脸,然后将目标人脸和源数据转换为中间表示形式,例如 UV 贴图、特征向量、3DMM参数等。

进行裁剪和对齐目标人脸,然后将目标人脸和源数据转换为中间表示形式,例如 UV 贴图、特征向量、3DMM参数等。

(d) 通过15种不同的面部伪造方法(它们分别基于编码器-解码器结构、对抗生成网络结构、循环神经网络结构等)对处理过的脸图![]() 进行伪造脸图

进行伪造脸图![]() 生成。

生成。

(e-f) 为了获得完整的伪造目标图像,将伪造目标人脸![]() 重新渲染回目标完整图像

重新渲染回目标完整图像![]() ,以获得

,以获得![]() 。特别地,1)

。特别地,1) ![]() 可以是如图 4 (e-1) 所示的面部,其中包含从眉毛到下巴的区域。2)

可以是如图 4 (e-1) 所示的面部,其中包含从眉毛到下巴的区域。2) ![]() 也可以是一个面部边界框,如图 4 (e-2,3) 所示,根据不同的伪造程序,该边界框与原始目标面部保持相同的边界框。

也可以是一个面部边界框,如图 4 (e-2,3) 所示,根据不同的伪造程序,该边界框与原始目标面部保持相同的边界框。

(g) 为了更好地反映现实世界中的数据分布,我们对伪造数据![]() 施加了包括36种类型的摄动扰动。我们遵循图像和视频质量评估中的常规做法,模拟了压缩、传输、捕获、色彩会失真,同时还提供了组合两种以上扰动的多重扰动。

施加了包括36种类型的摄动扰动。我们遵循图像和视频质量评估中的常规做法,模拟了压缩、传输、捕获、色彩会失真,同时还提供了组合两种以上扰动的多重扰动。

Part 5 评测标准

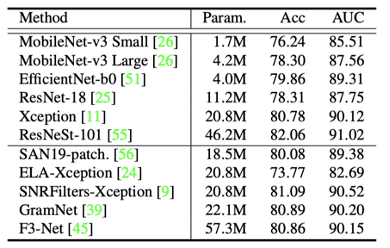

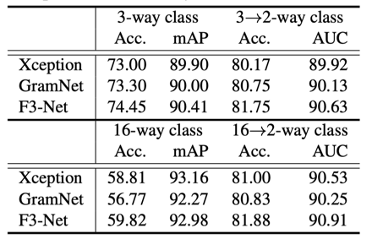

5.1 伪造图片分类

在给定伪造图像的情况下,我们提供了三种类型的伪造标签,即用于2分类(真实/伪造),3分类(真实,使用身份替换伪造方法,使用伪造且保留身份的伪造方法)和n分类(n=16,真实和15种伪造方法)分类任务。这些标签使探索不同的伪造类型或方法之间的相关性成为可能。

在图片分类任务中,我们提出了两个评测方案:

方案1:伪造方法内部评估。在伪造方法内部评估中,训练集中的所有真实数据和伪数据都用于训练模型,而验证集用于评估。在 ForgeryNet 中根据我们提供的标注,可以完成伪造的2分类(真/假)、3分类(真/身份信息保留的伪造方式/f身份信息修改的伪造方式)、n分类(n=16, 真和15种伪造方法)。

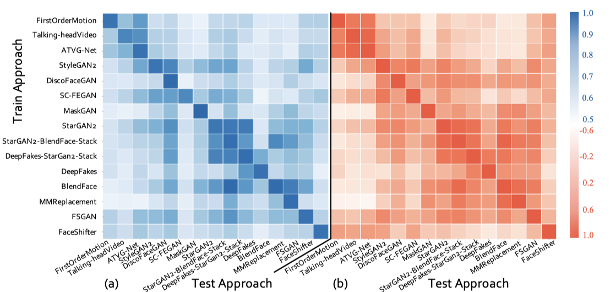

方案2:交叉伪造方法评估。为了进一步利用我们的数据评估训练的泛化能力,我们通过使用一种特定类型的操作训练评估的取证方法并与其他类型的测试进行交叉伪造评估。伪造类型可以是某种伪造方法大类(例如,替换身份),也可以是特定的方法(例如,ATVG-Net)。

我们测试了多种算法基线,Acc分数显示,随着类别数量的增加,分类变得更加困难,而mAP指标表明,判别能力反而变得更高。这表明更多的辅助信息可能使取证模型更具区分性。

图 5 伪造图片分类分析方法评估结果

图 6 交叉伪造方法评估性能表

5.2 伪造空间定位

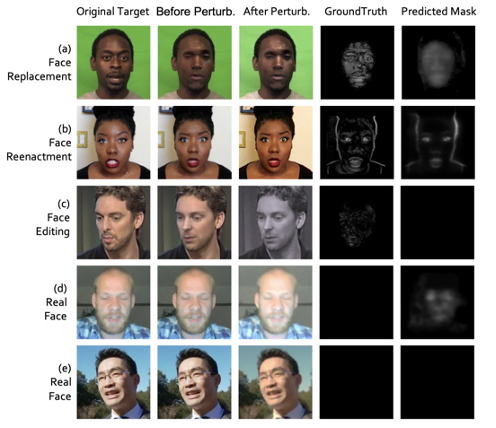

与分类任务相比,空间伪造定位旨在指定伪造区域。在ForgeryNet中提供了图像及其伪造部分的掩码图用于训练空间定位模型。

我们在伪造空间定位中评估了直接回归和其他两种分割方法的性能。在图7(c)中,很难检测到轻微的胡须变化,而在图7(d)中,实际图像在操作时被误判。

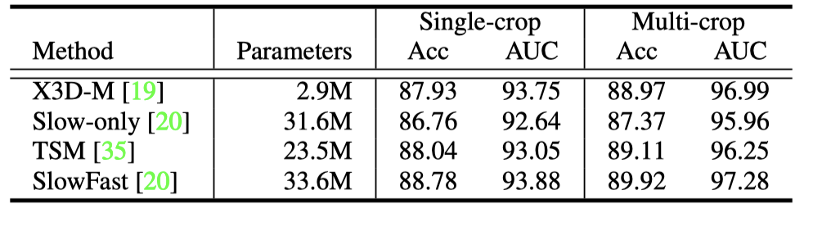

5.3 伪造视频分类

同伪造图像分类一样,我们提供了伪造方法的大类和方法标签。在ForgeryNet中根据我们提供的标注,可以完成伪造的2/3/n分类和跨伪造方法的泛化性测试。

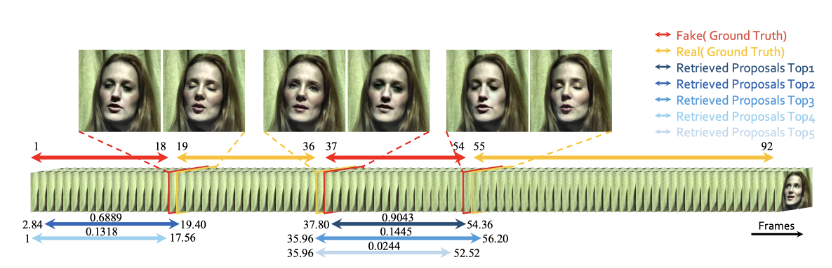

5.4 伪造时序定位

图 8 伪造时序定位分析

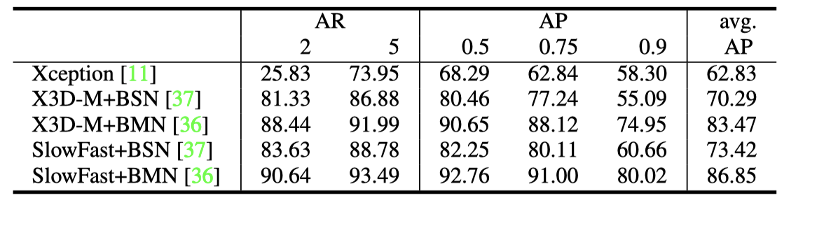

对于每个视频,要评估的取证方法都有望提供伪造片段的时间边界和相应的置信度值。目标是生成高质量建议,这些建议涵盖具有高时间重叠和召回的操纵段,我们使用主流的BSN和BMN方法对伪造的时序片段进行定位,其性能指标如图8和表所示。

Part 6 结语

本文提出了一个更加全面的深度伪造分析基准ForgeryNet,为图像和视频水平的人脸伪造分析。与现有的人脸伪造数据集相比,ForgeryNet数据来源广泛、伪造方法和质量多样、注释丰富,能够促进人脸伪造分析等领域的进一步研究和创新。对于未来的工作,我们欢迎有兴趣的研究人员贡献更多新颖的面部伪造方法,或对数据集进行更多的伪造分析,以促进深度伪造领域的发展。

论文链接

https://arxiv.org/abs/2103.05630

Project

https://yinanhe.github.io/projects/forgerynet.html

返回

返回